Secolul XXI a fost martorul AI (Inteligența Artificială) îndeplinind sarcini precum înfrângerea cu ușurință a oamenilor la șah sau predarea lor rapidă a limbilor străine.

O sarcină mai avansată pentru computer ar fi prezicerea probabilității unui infractor de a comite o altă infracțiune. Aceasta este treaba pentru un sistem AI numit COMPAS (Corectional Offender Management Profiling for Alternative Sanctions). Dar se pare că instrumentul nu este mai bun decât un tip mediu și poate fi și rasist. Ei bine, exact asta a descoperit o echipă de cercetători după ce a studiat pe larg sistemul AI care este utilizat pe scară largă de instituțiile judiciare.

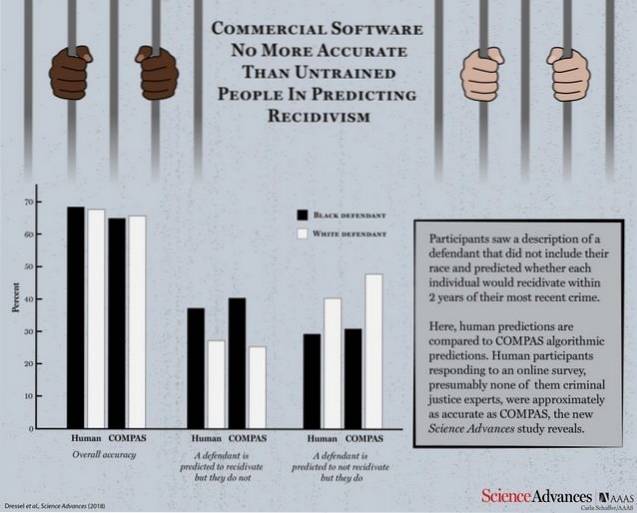

Potrivit unei lucrări de cercetare publicate de Science Advances, COMPAS a fost confruntat cu un grup de participanți umani pentru a-i testa eficiența și a verifica cât de bine se descurcă cu previziunile logice făcute de o persoană normală. Mașinii și participanților umani li s-au furnizat 1000 de descrieri ale testelor care conțin vârsta, infracțiunile anterioare, sexul etc. al infractorilor a căror probabilitate de repetare a infracțiunilor urma să fie prevăzută.

Cu informații mult mai puține decât COMPAS (doar 7 caracteristici comparativ cu cele 137 ale COMPAS), o mică mulțime de experți este la fel de precisă ca și COMPAS la prezicerea recidivei.

COMPAS a obținut o precizie generală de 65,4% în prezicerea recidivei (tendința unui criminal condamnat de a recidiva), care este mai mică decât precizia colectivă a participanților umani care se află la 67%.

Acum, ia-ți un moment și reflectă-ți în minte că sistemul AI, care nu este mai bun decât o persoană obișnuită, a fost folosit de instanțe pentru a prezice recidiva.

Software-ul comercial care este utilizat pe scară largă pentru a prezice recidiva nu este mai precis sau corect decât predicțiile persoanelor cu puține sau deloc expertize în justiție penală care au răspuns la un sondaj online..

Ce este și mai rău este faptul că sistemul a fost găsit la fel de susceptibil la prejudecățile rasiale ca și omologii săi umani atunci când li s-a cerut să prezică probabilitatea recidivei din descrierile care conțineau și informații rasiale ale infractorilor. Nu ar trebui să fiți prea surprinși acolo, deoarece AI este cunoscut pentru a prelua tiparele pe care profesorii săi umani îi vor programa să le învețe.

Deși ambele părți nu ating drastic un scor de precizie acceptabil, punctul de a folosi un instrument AI care nu este mai bun decât o ființă umană medie ridică multe întrebări.

Gadgetshowto

Gadgetshowto